扫码立即咨询

扫码立即咨询

扫码立即咨询

扫码立即咨询

ChatGPT角逐之战愈演愈烈。

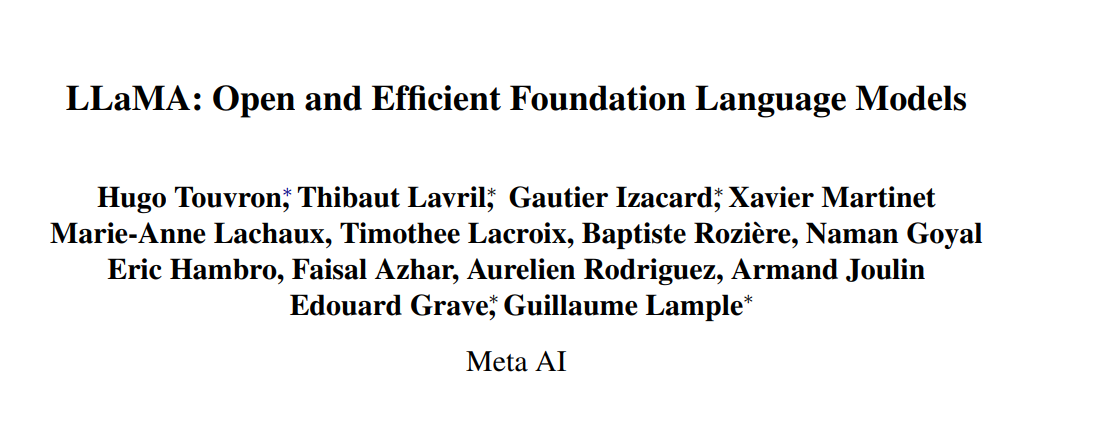

前几日,Meta 方面宣布加入微软、谷歌等公司在 AI 领域的市场竞赛,将正式推出一种针对研究人员、基于人工智能的新型大型语言模型 "LLaMA"(Large Language Model Meta AI)。

Meta 宣称,LLaMA 规模仅为竞争对手 ChatGPT 的“十分之一”,但性能却优于 OpenAI 的 GPT-3模型。

根据Meta官网发布的论文,LLaMA目前包含70亿、130亿、330亿和650亿这4种参数规模的模型。其中,参数规模最小的LLaMA7B也经过了超1万亿个tokens的训练。Meta表示,在大多数基准测试中,参数仅为十分之一的LLaMA-13B的性能优于OpenAI推出的GPT3(175B),也即支持ChatGPT的GPT3.5的前身。LLaMA-65B也可与业内领先的Chinchilla-70B和PaLM-540B竞争。

然而万万没想到的是,刚发布没几天,LLaMA的模型文件就提前泄露了。

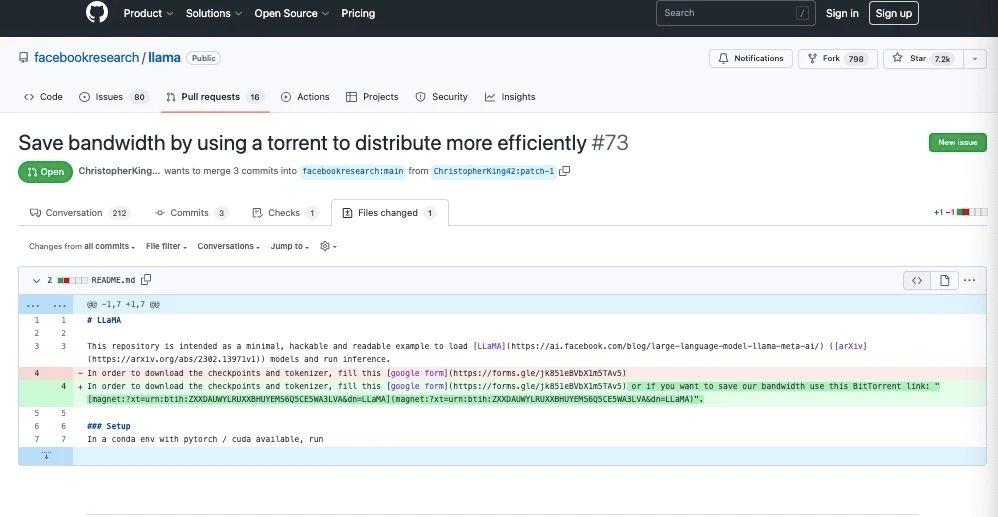

上周四,用户llamanon在4chan的技术板上发帖,通过种子文件(torrent)发布7B和65B的LLaMA模型,并且种子文件被合并到了Meta Research的 GitHub 上,同时一些项目维护者给予了批准,目前该项目在 GitHub 已收获7k+ 个星。

然而,泄密者最大的错误之一就是在泄密的模型中包含了他们的唯一标识符代码。

这个代码是专门用来追踪泄密者的,使用户llamanon的个人信息处于危险之中。

正所谓,LLaMA开源的不太体面,网友帮它体面了。

此外,4chan上的用户还为那些希望在自己的工作站上部署该模型的人创建了一个方便的资源。并提供了一个分布教程的指南,说明如何获得模型,并将修改后的权重添加到其中,以便进行更有效的推理。

更重要的是,这个资源甚至提供了一种将LLaMA集成到 在线写作平台KoboldAI的方法。

对于这件事究竟是Meta有意为之,还是无意泄漏,网友分成了两个派系:一方认为这次泄露事件是 Meta 方有意为之,另一方则认为只是单纯地被泄露。

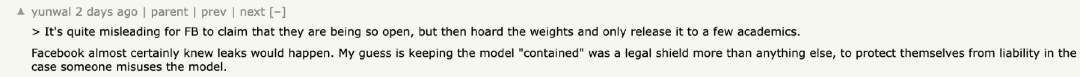

网友 yunwal 表示:“Facebook 几乎肯定知道会发生泄密事件。我的猜测是保持模型“受控”是比其他任何事情都更重要的法律保护,以在有人滥用模型的情况下保护自己免受责任。”

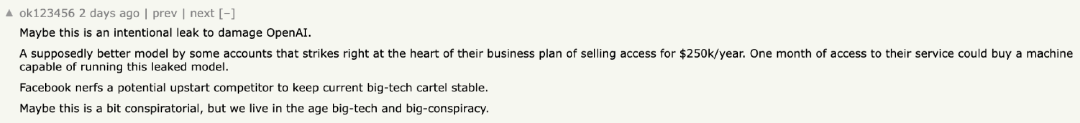

网友 ok123456 则猜测:“也许这是 Meta 故意泄露的,以对抗 OpenAI。一些客户认为这是一个更好的模型,它恰好击中了他们以每年 25 万美元的价格出售访问权的商业计划的核心。访问他们的服务一个月可以购买一台能够运行这种泄露模型的机器。Facebook 削弱了一个潜在的新贵竞争对手,以保持当前的大型科技卡特尔稳定。也许这有点阴谋论,但我们生活在大科技和大阴谋的时代。”

也有网友反驳上述观点:“为什么要泄露它,而不是将它与关于开放和民主化 AI 等新闻稿一起发布?”,有网友称:“这根本不是阴谋。另请参阅 IE、Android、Kubernetes……”

目前,Meta 方面暂未对此事做出回应。有 Meta 员工表示:“Meta 员工可能没有注意到或仍在思考如何做出反应,因此 PR 仍在进行中。”

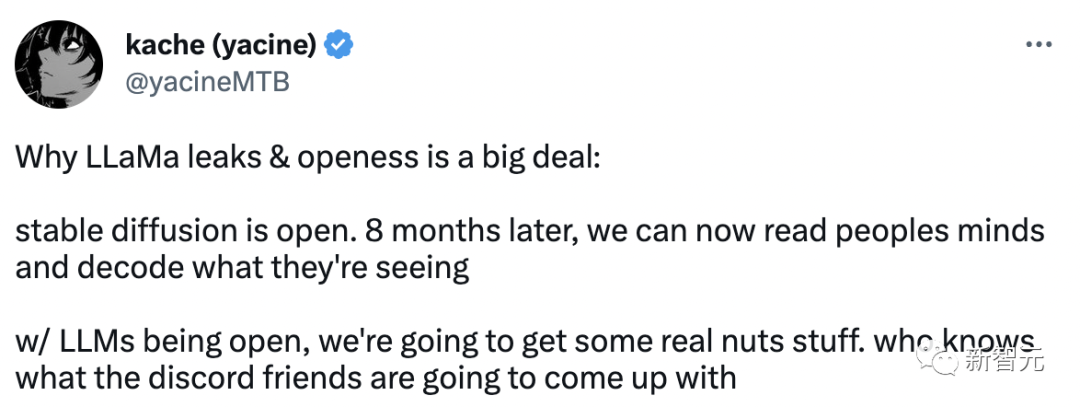

事实上,LLaMA的泄露和开源是一个大事件:

Stable Diffusion开源了。8个月后,我们现在就可以读懂别人的思想,解码他们看到的一切。

随着LLMs的开放,我们将得到一些真正的疯狂的东西。

LLaMA发布不久后,网友发现这个最小参数的模型也需要近30GB的GPU才能运行。然而,通过比特和字节库进行浮点优化,他们能够让模型在单个NVIDIA RTX 3060上运行。

此外,GitHub 上的一名研究人员甚至能够在Ryzen 7900X CPU上运行LLM的7B 版本,每秒能推断出几个单词。

那么LLaMA模型究竟怎样?国外小哥便对它进行了评测。

LLaMA在很多测试中表现出色。

在大规模多任务语言理解方面,即使相对较小的13B模型也与GPT-3水平相当,而GPT-3的规模是其13倍。33B版本远远优于GPT-3, 65B则可与现有最强大的LLM模型--谷歌的540B参数的PaLM竞争。

对于需要应用逻辑或计算进行处理的文本方面,LLaMA表现优秀,在定量推理方面可与PaLM相较,甚至比后者的代码生成能力更好。

鉴于这些结果,LLaMA似乎是目前最先进的模型之一,而且,它足够小,不需要多少资源就能运行。这使得LLaMA对于人们来说充满诱惑,想让人和它玩玩,见识一下它的本领。

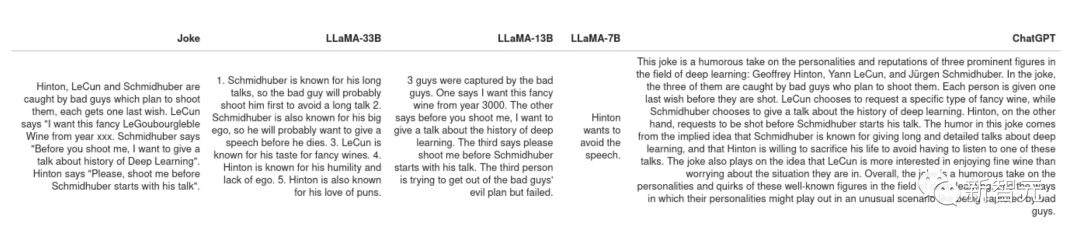

一、解释笑话

PaLM原始论文中展示了一个非常酷的用例:给定一个笑话,让模型解释它为什么好笑。这个任务需要把尝试和逻辑结合起来,PaLM之前的所有模型都无法做到这一点。将其中一些笑话交给LLaMA和ChatGPT来解释,有些笑话语言模型能get到,比如Schimidhuber冗长无聊的发言。

但总体上LLaMA和ChatGPT都没什么幽默感。

不过两者应对听不懂的笑话的策略不同,ChatGPT会产生「一堵文本墙」,希望其中至少有一些语句是正确答案,这种行为就像是不知道答案的学生,希望老师能从他们的一通乱说里找出答案。

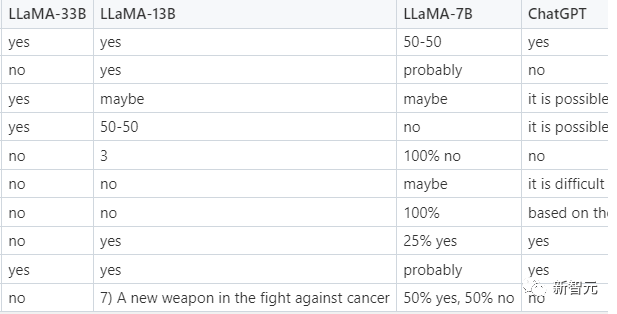

二、零样本归类

这是一种很实用的功能,使得人们可以用LLM代替评分员来生成训练集,然后在这些训练集上训练较小的可服务的模型。

一个更有挑战性的任务是点击广告分类,由于连人类都不能就什么是点击广告达成一致,在提示中会向模型提供一些例子,所以事实上这是一个少样本而非零样本归类。下面是LLaMA的提示。

测试中只有LLaMA-33B会设法遵循所要求格式给出答案,而且其预测是合理的,ChatGPT表现次之,能给出比较合理的答案,但时常不按规定的格式回答,较小的7B、13B模型则不太适合完成这项任务。

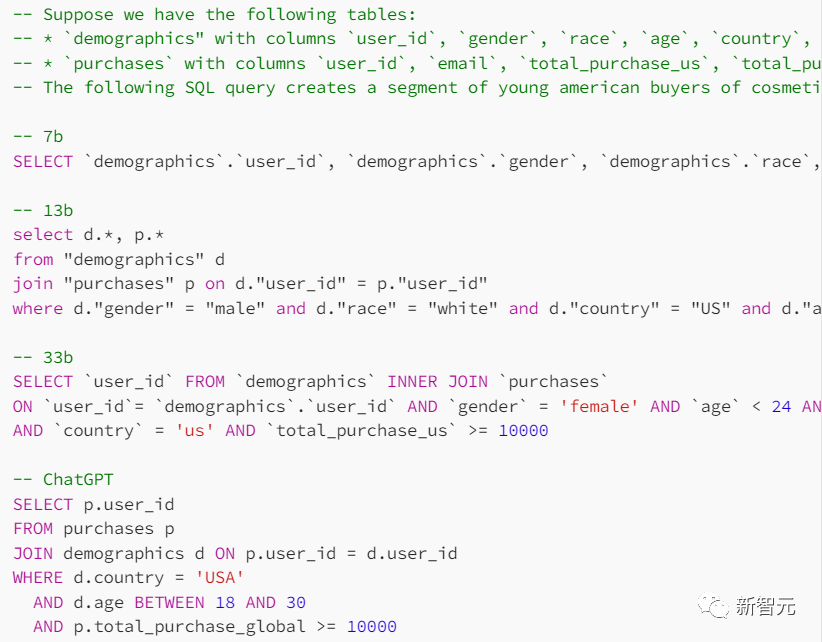

三、代码生成

虽然法LLM在人文方面表现出色,但不擅长STEM科目,那么LLaMA在这方面的表现如何呢?

在提示中,给出搜索表的形式和希望达到的目的,要求模型给提供SQL查询语句。ChatGPT在这项任务中表现更好一点,但语言模型给出的结果总体都不太靠谱。

在与ChatGPT对比进行的各项测试中,LLaMA并没有如想象中一样大获全胜。当然如果其间差距只是由RLHF(带有人类反馈的强化学习)造成的,那小型模型的未来可能会更光明。

部分来源:新智元

您想入驻成为Tech+技术加大咖?获取更多数字化案例&研究报告?寻求合作?赶紧扫码咨询,同时您也可扫码申请加入企业数字化精英社群,链接10000+优质CXO资源、参与高质高频线上线下活动、精准对接创新技术、发现职业新机遇.......